상세 컨텐츠

본문

딥러닝 모델에서 중요한 구성 요소 중 하나가 바로 Activation Function(활성화 함수)입니다. 이 함수를 쉽게 설명하고 구체적으로 이해할 수 있도록 하겠습니다.

1. Activation Function이란?

Activation Function은 인공 신경망의 뉴런에서 입력 신호를 받아 출력 신호로 변환하는 수학적 함수입니다. 뉴런은 입력 신호를 받아 가중치를 곱하고, 그 합을 Activation Function에 통과시켜 최종 출력을 생성합니다.

2. 왜 필요한가?

딥러닝 모델에서 Activation Function이 필요한 이유는 다음과 같습니다:

- 비선형성 부여: 신경망에 비선형성을 추가하여 복잡한 패턴을 학습할 수 있게 합니다. 단순히 선형 변환만으로는 복잡한 데이터 분포를 학습할 수 없습니다.

- 출력 범위 조절: 출력값의 범위를 제한하여 안정적인 학습을 돕습니다. 예를 들어, 출력값을 0과 1 사이로 제한하면 학습이 더 안정적으로 진행될 수 있습니다.

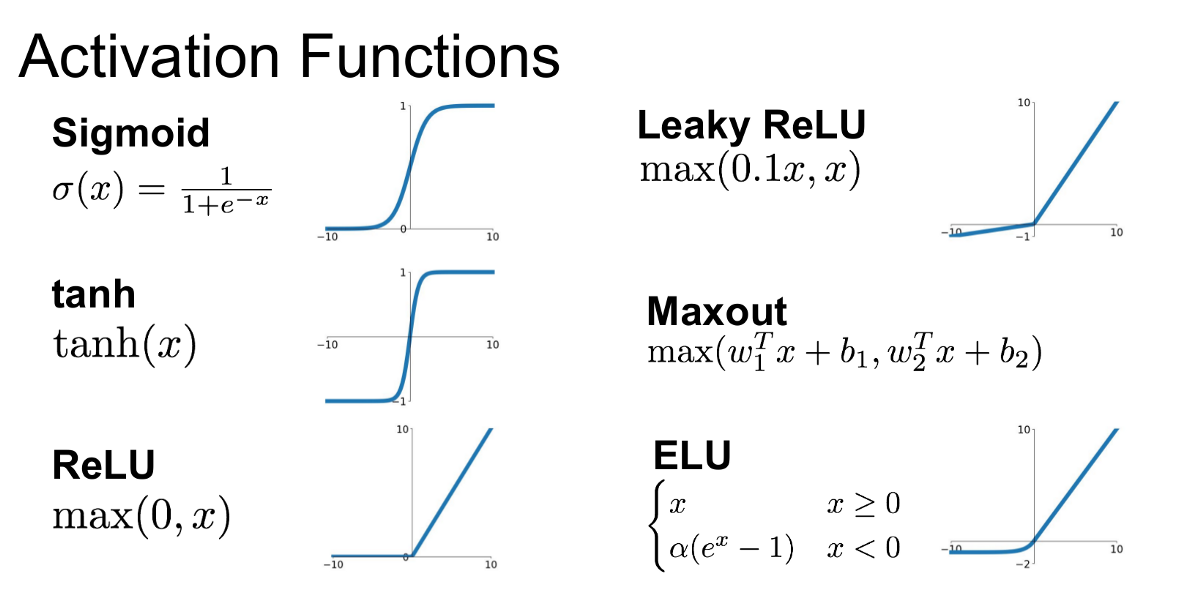

3. 주요 Activation Function 종류

Sigmoid Function

Tanh (Hyperbolic Tangent)

ReLU (Rectified Linear Unit)

Leaky ReLU

Softmax

4. 어떻게 선택할까?

- Sigmoid, Tanh: 작은 네트워크나 출력이 확률로 해석되는 경우 유용하지만, Vanishing Gradient 문제를 주의해야 합니다.

- ReLU: 대부분의 경우 기본 선택으로 사용되며, 깊은 신경망에서도 잘 작동합니다.

- Leaky ReLU: Dying ReLU 문제를 해결하고자 할 때 사용합니다.

- Softmax: 분류 문제의 출력층에서 사용합니다.

와포의 생성형AI인 스노피(SnowPea)는 다음과 같은 제품군으로 이루어져 있습니다.

SnowPea-VS : Video Studio로 SnowPea-VG(Video Generator)와 Video editor가 결합된 제품

SnowPea-VH : Virtual Human으로 가상의 인간

SnowPea-VG : Video Generator으로 영상을 생성

SnowPea-IG : Image Generator으로 이미지를 생성

SnowPea-LLM : Large Language Model으로 챗봇 생성

SnowPea-Voice : TTS(Text-to-Speech)등 음성 생성

SNOWPEA AI

상상만으로 만드는 새로운 세상, 스노피 AI가 여러분을 초대합니다. 텍스트만으로 여러분의 상상을 영상으로 만들어보세요. 스노피 AI는 영화, 애니메이션, 광고 등 모든 분야의 영상을 쉽고 빠

wafour.com

'SnowPea(스노피) AI' 카테고리의 다른 글

| [스노피 AI] Vision Transformer 쉽게 이해하기 - 3. Patch Embedding in Vision Transformers (0) | 2024.06.20 |

|---|---|

| [스노피 AI] Vision Transformer 쉽게 이해하기 - 2. Transformer Architecture (1) | 2024.06.13 |

| [스노피 AI] Vision Transformer 쉽게 이해하기 - 1. Introduction (0) | 2024.06.13 |

| [스노피 AI] 퍼셉트론(Perceptron) 쉽게 이해하기 (0) | 2024.06.03 |

| [스노피 AI] 디퓨전 모델(Diffusion model)에 대한 쉬운 설명 (1) | 2024.06.03 |

댓글 영역